„Co to jest różniczka? – zapytano matematyka.

Różniczka to wyniczek odejmowanka – odpowiedział”

🙂

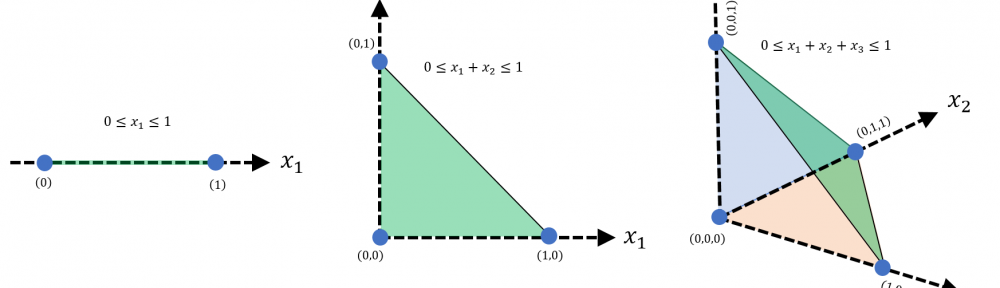

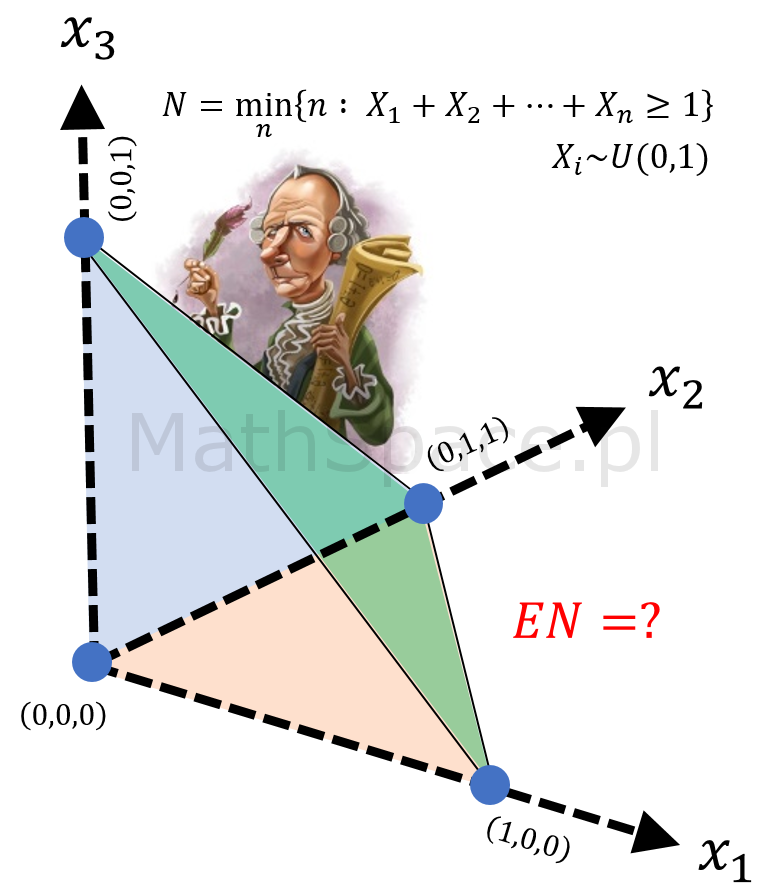

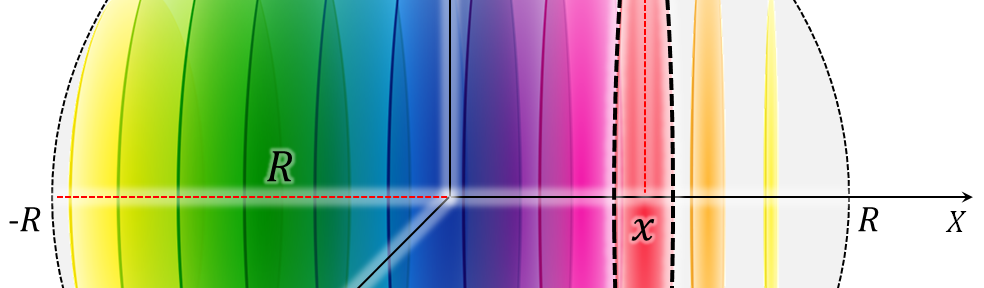

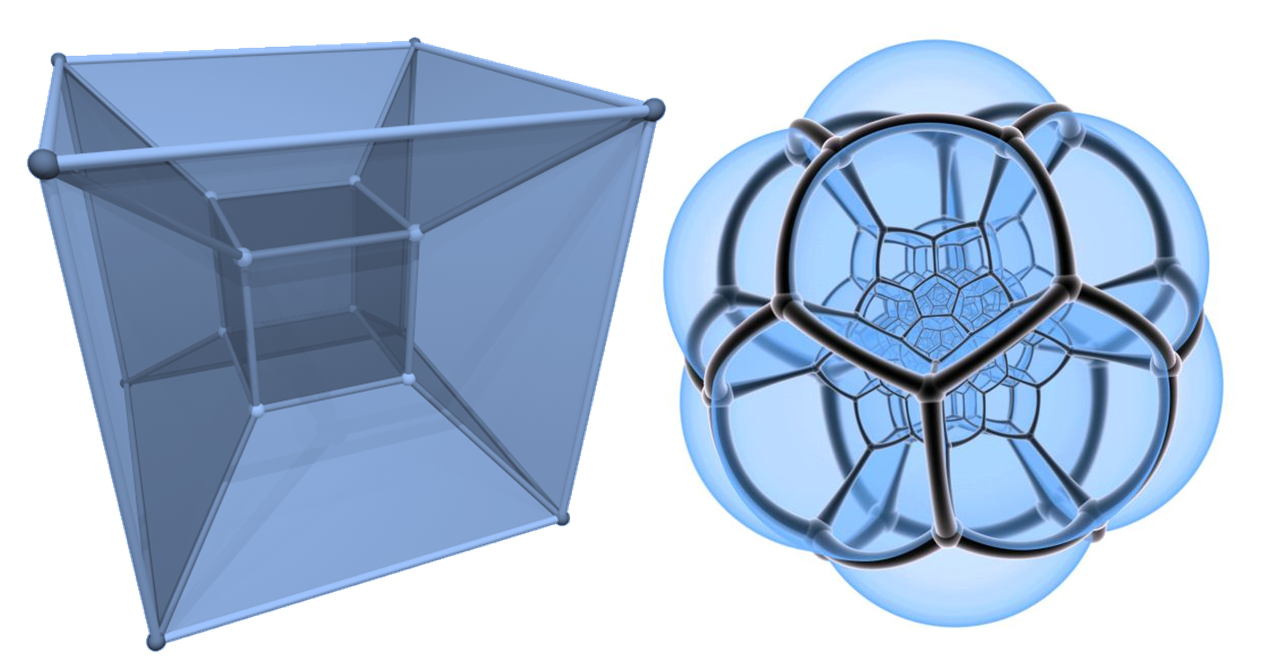

Wzór Taylora to jeden z elementów, które stanowią esencję rachunku różniczkowego i całkowego. Oto, w magiczny sposób, na bazie sekwencji informacji o funkcji, dotyczących tylko jednego jej wybranego punktu, możliwe jest bardzo precyzyjne odtworzenie zmienności funkcji w pobliżu ustalonego punktu. Wzór Taylora, nazywamy często rozwinięciem Taylora funkcji $f(x)$ w otoczeniu punktu $x_0$, faktycznie „rozwija” funkcję do postaci sumy funkcji elementarnych $a_n(x-x_0)^n$, stanowiących atomy wielomianów. W efekcie otrzymujemy nie tylko efektywną aproksymację wartości funkcji, ale również nową „łatwiejszą” jej formę.

Wielomian Taylora

Twierdzenie Taylora: Dla funkcji $f:\mathbb{R}\to\mathbb{R}$ $n$-razy różniczkowalnej $(n\geq 1)$ w punkcie $x_0\in\mathbb{R}$, istnieje funkcja $h_n:\mathbb{R}\to\mathbb{R}$, że

$$f(x)=\underbrace{\displaystyle\sum_{k=0}^n\frac{f^{(k)}(x_0)}{k!}(x-x_0)^k}_{wielomian-aproksymacja~f(x)}+\underbrace{h_n(x)(x-x_0)^n}_{reszta}$$

$$f(x)=f(x_0)+\frac{f^{(1)}(x_0)}{1!}(x-x_0)^1+\frac{f^{(2)}(x_0)}{2!}(x-x_0)^2+\ldots$$

$$\ldots+\frac{f^{(n)}(x_0)}{n!}(x-x_0)^n+h_n(x)(x-x_0)^n$$

oraz

$$\displaystyle\lim_{x\to x_0}h_n(x)=0$$

Przez $f^{(k)}(x)$ oznaczamy pochodną rzędu $k$ funkcji $f(x)$.

Twierdzenie Taylora nosi nazwę od angielskiego matematyka Brooka Taylora, który opracował je w 1712 roku. Samą własność wcześniej odkrył James Gregory – dokonał tego w 1671 roku.

Continue reading